Un habitant de Strasbourg âgé de 37 ans a été interpellé le 3 avril après avoir exprimé son intention de tuer un agent des services secrets via une conversation avec ChatGPT. Cette affaire a été révélée par le Parquet de Strasbourg, dirigé par Clarisse Taron, qui a précisé que l'individu avait demandé des conseils sur la manière de se procurer une arme.

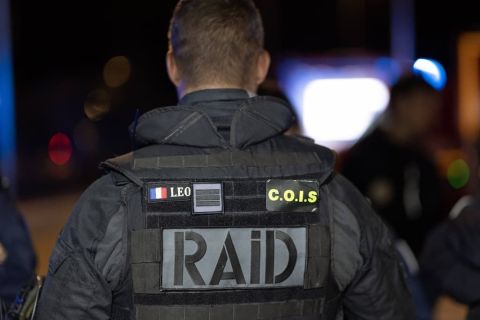

Ces échanges ont été repérés par le FBI, qui a immédiatement informé les autorités françaises via la plateforme Pharos, dédiée au signalement des contenus illégaux. Les enquêteurs français ont alors déployé le Raid pour procéder à l'interpellation de l'homme.

Le mis en cause, dont les antécédents psychiatriques sont notables, a été placé en garde à vue avant que celle-ci ne soit levée. Il a ensuite été hospitalisé sous contrainte. Selon la procureure Taron, « à ce stade, il n’y a pas d’infraction suffisamment caractérisée, le mis en cause ayant uniquement interrogé une IA ». Face à cette situation, l'affaire a finalement été classée sans suite.

Ce cas soulève d'importantes questions sur la responsabilité et la régulation des technologies d'intelligence artificielle, en particulier concernant la manière dont les utilisateurs s'engagent avec ces outils. Des experts en sécurité et en éthique, comme le Dr Camille Lefèvre, signalent que « de tels incidents mettent en lumière les risques d'une libre curation d'informations potentiellement dangereuses » et interpellent les développeurs sur la nécessité d'une surveillance accrue des contenus générés par les IA.

En France, d'autres cas similaires ont été évoqués par Le Monde, mettant en lumière les défis qui se profilent à l'horizon de l'interaction entre l'intelligence artificielle et la justice. Cela souligne l'urgence d'une dialogue ouvert entre les spécialistes et les législateurs pour mitiger les risques associés à l'usage des technologies d’IA.