Des entreprises se spécialisent dans la détection de contenus générés par l'intelligence artificielle (IA), offrant des services payants pour "humaniser" ces textes. Cependant, une enquête de l'AFP met en lumière des pratiques douteuses derrière ces prétentions. Ces outils, censés lutter contre la désinformation, contribuent en réalité à discréditer des contenus légitimes.

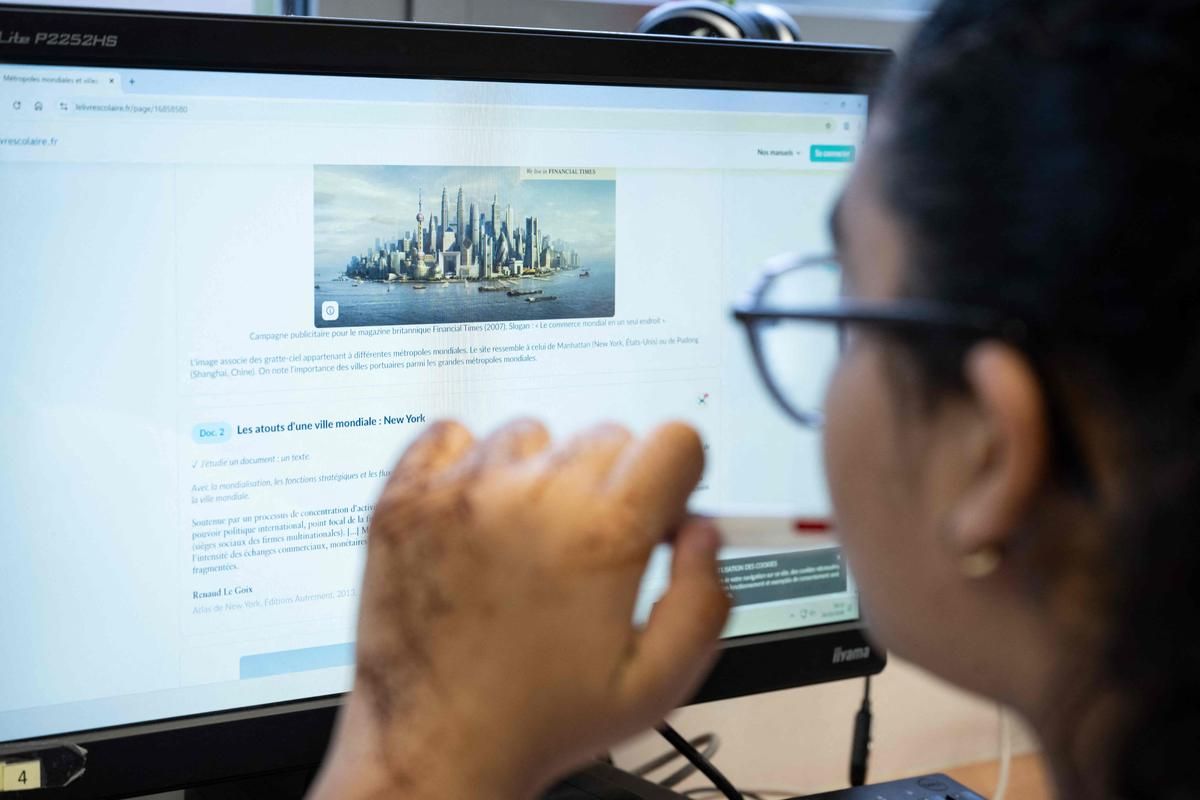

Qu'il s'agisse d'articles d'actualité concernant des sujets graves ou d'œuvres littéraires, ces détecteurs classent souvent à tort le contenu comme étant produit par l'IA. Par exemple, l'outil JustDone AI a analysé un article sur la guerre au Moyen-Orient, affirmant à tort qu'il contenait 88 % de texte généré par une machine, tout en offrant un service payant pour "remodeler" le texte afin d'éliminer ces soi-disant traces d'une origine non-humaine.

Cette tendance inquiétante s'inscrit dans un contexte où la désinformation générée par des IA prolifère sur les réseaux sociaux. Des chercheurs et des journalistes comme ceux de l'AFP s'inquiètent des implications de tels outils, qui risquent de semer la confusion tout en ajoutant une couche inutile à une problématique déjà complexe.

Des technologies peu fiables

Des études montrent que ces outils peuvent présenter des résultats erronés, ce qui peut nuire à la réputation des auteurs et à la crédibilité des contenus. Les chercheurs avertissent que ces systèmes, loin de détecter l'IA, peuvent servir d'outils de désinformation, pouvant également être utilisés à des fins politiques. Par exemple, certains influenceurs en Hongrie ont utilisé ces logiciels pour discréditer les documents de l'opposition durant une campagne électorale.

Les repercussions sur la créativité

Selon Debora Weber-Wulff, universitaire allemande spécialisée dans le domaine, ces outils ne sont pas de véritables détecteurs mais plutôt des escroqueries qui cherchent à vendre un service d'humanisation. Elle souligne que les résultats de ces outils peuvent mener à des productions textuelles absurdes, souvent qualifiées de "phrases torturées".

Les implications vont au-delà des analyses erronées. Avec de plus en plus d'étudiants et de professionnels exposés à ces services, la question de la confiance envers les contenus produits devient primordiale. Les instances académiques, telles que l'Université Cornell, ont affirmé qu'aucune relation formelle ne les liait à ces outils de détection, et elles mettent en garde contre leur efficacité réelle.

En conclusion, les utilisateurs doivent aborder ces outils avec une grande prudence, conscient qu'ils ne sont pas toujours fiables et pourraient nuire à la véracité des contenus qu'ils visent à protéger.